鹰,搏击长空而无畏。

鹰,大千尽览而敏锐。

鹰,动如雷霆而持重。

海鹰资讯,力求以鹰一般的气魄、视野和迅捷去打造专业的情报资讯,让繁复世界中最有价值的情报尽收眼底。

作者

北京海鹰科技情报研究所 韩雨

人工智能在军事应用方面前景广阔,其中自动目标识别(Automatic Target Recognition)可能是最重要的应用之一。当前,通过机器学习创建自动目标识别系统面临的一个主要问题是,如何收集高质量的标记数据集。美国智库兰德公司日前发布了一份研究报告,探索用人造图片数据集代替真实照片对目标检测算法进行训练的可能性,得出的结论是人造图片不能代替真实照片,但是人造图片可以作为现有真实照片数据集的补充,从而提升目标检测算法的性能。

研究背景

自动目标识别可能是当今人工智能和机器学习最重要的军事应用之一,高性能自动目标识别系统可以让各军种更加及时、准确、完整地利用情报监视侦察(ISR)传感器的数据,发出威胁警告。随着人工智能深度学习方法近期取得的进展,目标检测正在成为现实。日常生活中,谷歌的图像搜索、Facebook的照片人像标记以及苹果iPhone的人脸识别技术便是例证。成功创建军用自动目标识别系统面临的主要障碍在于,如何审编经过仔细标记的数据集,从而对其进行训练。

数据是构建高性能机器学习系统的主要原材料。对于机器学习系统来说,人类负责提供系统训练数据,通过在训练数据集上运行算法,机器学习系统生成规则,使其能够接收输入并提供正确的输出。因此,数据的质量、数量、代表性和多样性将直接影响到机器学习系统的运行性能。

美国国防部实施的Maven计划便是一个很好的例子,该项目旨在构建一种自动目标识别系统,用于分析无人机获取的视频片段。Maven计划采用市面公开销售的人工智能/机器学习算法,但需要利用10万多张手动标记照片来训练系统,让系统能够识别出每一个目标。生成如此规模的训练集是一项浩大工程,而且,最终的自动目标识别系统可能仍然无法识别新环境和新背景中的目标。本研究的一大初衷是,当发生冲突时,需要在以前未曾遇到的环境或背景下,快速创建敌方军事装备的标记数据集。在这种情况下,如果能够充分掌握目标信息,就可以创建出准确的三维模型,通过本研究探索的这类方法,或许就能快速生成真实的标记数据集。

研究内容

本项目研究了一种训练自动目标识别系统的新方法。研究人员没有使用手动标记的真实照片,而是通过宏命令和商用高质量环境仿真器构建人造图片训练集。利用软件可以将预期目标的3D渲染与模拟环境相结合,从而在不同的环境和照明条件下,从不同的观察位置生成目标的人造图片。然后在该模拟数据上训练目标检测模型,并在真实数据上对该模型进行测试。研究工作分为两大任务:数据生成和图像分类。

研究人员使用高机动性多用途轮式车辆作为测试对象,因为这种车辆既是军事目标,也是民用领域易于获取的研究对象。项目组租了一辆高机动性多用途轮式车辆,并聘请了一名无人机操作员在一天中的不同时间,从空中不同位置,以不同角度拍摄照片。

本项目的测试内容是,通过高质量人造图片成功训练出的目标检测模型能否在真实照片上具有良好表现。研究人员在作战相关场景的背景下研究目标检测模型的域适应,项目组粗略地将作战相关场景定义为关注目标是坦克、高机动性多用途轮式车辆、面空导弹等军事装备的场景。此外,作战相关场景还包括军事装备所在地环境,这些环境都与未来军事冲突中可能合理存在的环境密切相关。本研究生成了两种作战相关数据集(数据域)。第一种是人造图片数据集,第二种是用于评估的真实照片数据集。如果模型在取自两种域的图像上表现良好,则可以说模型能从一种域迁移到另一种域。

01

生成人造图片数据集

项目组使用电子游戏平台《武装突袭3》生成用于训练目标检测算法的人造图片。《武装突袭3》是一款战术类第一人称军事模拟电子游戏,其最引人之处在于游戏地图编辑器和内置“精彩镜头”模式,支持用户将3D目标模型(包括用户生成的模型)放置到各种完全可定制的环境中。该模式还支持通过全面用户界面将这些场景捕获为静态图像或视频,其脚本功能可实现最大程度的用户控制。

项目组使用这种脚本功能生成作战相关场景的人造图片。研究人员开发的软件可以系统地将高机动性多用途轮式车辆等目标模型放置在地图中的多个预设位置,并改变相机的相对位置和角度。为确保从各种角度生成目标图像,选择的相机位置是以目标为中心形成半圆顶,选择的相机角度则能保证生成的图像以目标为中心。生成图像用的背景地图是伊拉克东部迪亚拉省(Diyala)的地形图。《武装突袭3》生成图像示例见图1。每张图像均包含一台位于中心位置的高机动性多用途轮式车辆,周围则是黑色边界框。

为训练目标检测算法,还需要每张图像中目标的位置和标记。项目组采用边界框格式来存储每个目标的位置。边界框是将图像内的关注目标框入其中的矩形(见图1)。项目组使用《武装突袭3》的脚本功能,为制成的每一张图像自动生成边界框。但是自动图像生成花费的时间比预期的要长,生成和保存2500幅高分辨率图像耗费了4个小时。

图 1 《武装突袭3》生成图像示例

(注:每张图像上都有一辆高机动性多用途轮式车辆,车辆所处环境与伊拉克迪亚拉省相似,此外还显示有高机动性多用途轮式车辆四周的黑色边界框。)

02

生成真实照片数据集

为评估人造图片训练模型的有效性,需要真实世界照片数据集作为比较基准。理想情况下,真实世界照片数据集中的图像需尽可能与《武装突袭3》人造图片类似,才能将人造图片的训练作为影响目标检测算法的单一变量。

因此,项目组的两名成员前往加利福尼亚州耶莫,对照片拍摄过程进行监督。本项目中使用的高机动性多用途轮式车辆是从美国海军陆战队退役的M1038A1版,照片拍摄工作由专业无人机飞行员兼摄影师完成。为确保在照片拍摄中捕获的图像与《武装突袭3》人造图片数据集的图像相似,项目组考虑了各种场景,包括开阔区域、车辆被部分遮挡的场景(例如被树木遮挡)以及含相似形状的非军事车辆等诱饵目标的场景。为提供补充视角,项目组还不断调整无人机的角度和高度。此外,为提供不同光影效果,项目组全天将车辆多次摆放在同一处位置反复进行拍摄。照片拍摄持续了大约五个小时,在此期间,项目团队生成了大约22 GB的数据,收集的数据包含1000多幅静态图像,还有各种可从中提取更多静态图像的跟踪(运动的车辆)和轨道(静止的车辆)视频。其中四幅图像如图2所示,图3并排比较了车辆的实物特写照片与车辆人造图片。最后,项目组对这些图像进行手动标记,以便在图像上对目标检测算法进行训练,手动标记每张图像大约需要30秒。

图2 实拍照片示例

(注:每张照片上都有一辆被黑色边界框包围的高机动性多用途轮式车辆。)

图3 车辆实物特写照片(左)与《武装突袭3》生成的车辆人造图片(右)并排比较

03

数据集小结

项目组共收集了三个不同的图像数据集:一个包含《武装突袭3》中的640幅人造图片,一个包含418幅实拍照片,一个包含214幅从拍摄的高清视频静态帧中获取的实物图。静态帧用作图像测试数据集,而另外两个数据集则用于训练,如表1所示。

表1 数据集小结

名称

图像数量

《武装突袭》图片-训练

640

实拍图像-训练

418

实拍图像-测试

214

但是,训练计算机视觉所需图像的数量通常为几十万到几百万张,以这种标准来衡量,这些数据集都太小了。实拍图像数据集需要进行手动标记,因此数据集的大小受到了限制。为避免纳入过于相似的图像,从视频静态帧创建的实拍图像测试数据集的大小也受到了限制。此外,项目组原本期望能够通过脚本快速、自动地获取大量人造图片,然而从《武装突袭3》中收集图像,面临着与从视频中提取静态帧同样的困难。虽然数据集收集和标记这两项步骤可以自动完成,但是设置每一种环境还有一些工作要做,在每一种环境下,相机从不同角度和高度拍摄多张图像(如上文所述),图像之间不能过于相似这一要求严重限制了收集大量图像的能力。

04

实验方法

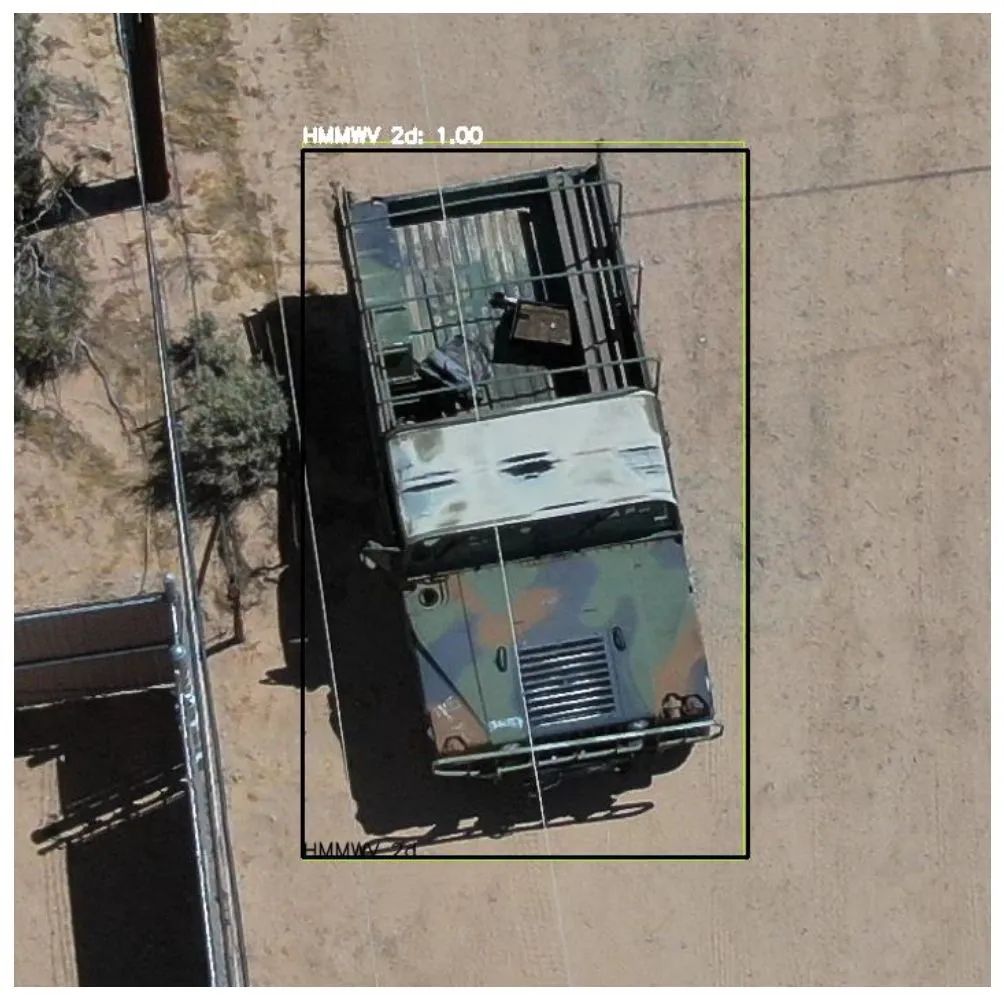

计算机视觉算法的实现是软件工程面临的重大挑战,项目组选择使用基于区域的卷积神经网络(RCNN)的开源实现,名为Mask-RCNN,由Facebook人工智能研究实验室(FAIR)提供。简言之,当给定一幅图像作为输入时,Mask-RCNN算法以图像内候选目标周围的边界框形式返回预测。边界框示例如图4所示,黑色矩形框代表“地面实况”,这是使用标记软件在目标周围绘制边界框手动确定的,黄绿色框代表Mask-RCNN预测,在本例中,两框几乎完全重合。

图4 边界框目标检测

(注:此为正确检测示例。黑色边界框是用手工贴标机绘制而成,黄绿色框表示Mask-RCNN算法的预测。算法除了预测图像的位置以外,还预测了目标类别为双门高机动性多用途轮式车辆,并报告了预测的置信度估计(在本例中为100%))

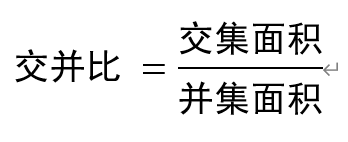

为训练算法,需要采取一种方法将预测的边界框和地面实况边界框进行对比。理想情况下,两框应完全重合。两框的一致程度通过交并比衡量。顾名思义,交并比是指两个边界框的交集面积与并集面积之比:

相关示例如图5所示。如前所述,地面实况用黑色矩形表示,算法所作的预测用黄绿色框表示。交集用红色方块表示,交并比值为交集面积与两框内所含总(并集)面积之比。在实践中,需设置交并比阈值,如此一来,只有在预测的边界框与地面实况边界框充分重合的情况下,才会判定预测正确(真阳性)。注意:交并比值与Mask-RCNN算法的输出是分开的,并且仅用于确定预测是否正确。此外,如果算法预测图像的空白区域中存在目标,则交并比值为零。

图5 交并比示例

(注:算法预测的边界框(黄绿色框)与地面实况边界框(黑色框)完全重合的情况非常少,交并比用于量化像这样不完美的预测。交并比为黑色框与绿色框交集面积(红色标记的共享面积)除以两框总面积所得数值。在本例中,交并比为0.3。)

目标检测算法(本研究中为Mask-RCNN算法)的性能通常用精确率和召回率衡量,公式分别如下:

其中TP、FP和FN分别代表真阳性、假阳性和假阴性检测的值。精确率和召回率的范围均是0到1,如果没有进行正确识别,则为0。未产生假阳性错误时,获得完美的精确率值1,而未获得假阴性时,获得完美的召回率值1。因此,单独一项数值并不能充分洞悉模型性能,必须同时使用两项值才能对其全面了解。

精确率和召回率值既取决于预测边界框所需的置信度阈值,又取决于决定预测是否正确的交并比阈值。计算机视觉研究的标准做法是报告这些值范围内的平均结果,得出“平均精确率均值”(mAP)和“平均召回率均值”(mAR)。本研究使用了为COCO检测挑战赛制定的评估标准,平均精确率均值和平均召回率均值是通过以下10个交并比阈值求均值所得:

IoU ∈ (0.5, 0.55, 0.6, 0.65, 0.7, 0.75, 0.8, 0.85, 0.9,0.95)

05

实验结果

项目组收集了在几个不同数据集上训练的Mask-RCNN模型性能的相关数据,包括纯真实照片数据集、《武装突袭3》纯人造图片数据集以及上述两者共同组成的混合数据集。

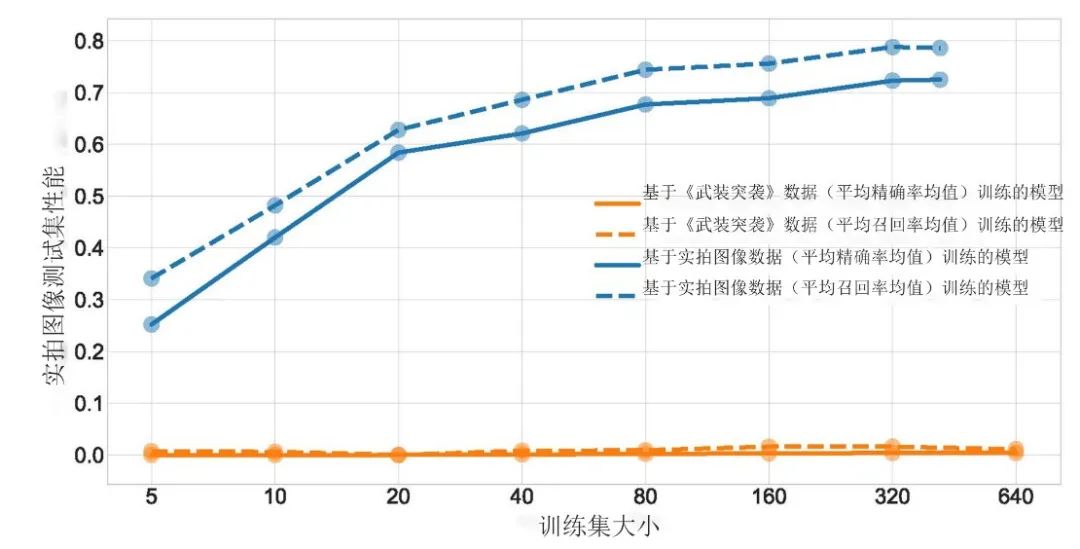

基于《武装突袭3》数据的训练

图6展示了首批主要结果,本图为基于高机动性多用途轮式车辆真实照片训练的模型与基于《武装突袭3》人造图片训练的模型之间的性能对比图,两种模型均参照高机动性多用途轮式车辆真实照片组成的相同测试数据集进行评估。本图明确表明,域适应并未得以实现:基于人造图片训练的模型并未迁移到真实照片测试集。尽管肉眼判断图像之间明显相似,但是《武装突袭3》训练模型的平均精确率均值和平均召回率均值都是基本为零。

图6 基于实拍图像评估的Mask-RCNN算法的性能

(注:蓝色曲线对应基于真实照片训练的模型,橙色曲线对应基于《武装突袭3》人造图片训练的模型。前者在测试数据集上表现良好,而后者则完全失败。性能根据平均精确率均值(mAP,实线)和平均召回率均值(mAR,虚线)两项数值进行衡量,两项数值均按前文所述通过求得一组交并比值的均值而算得。)

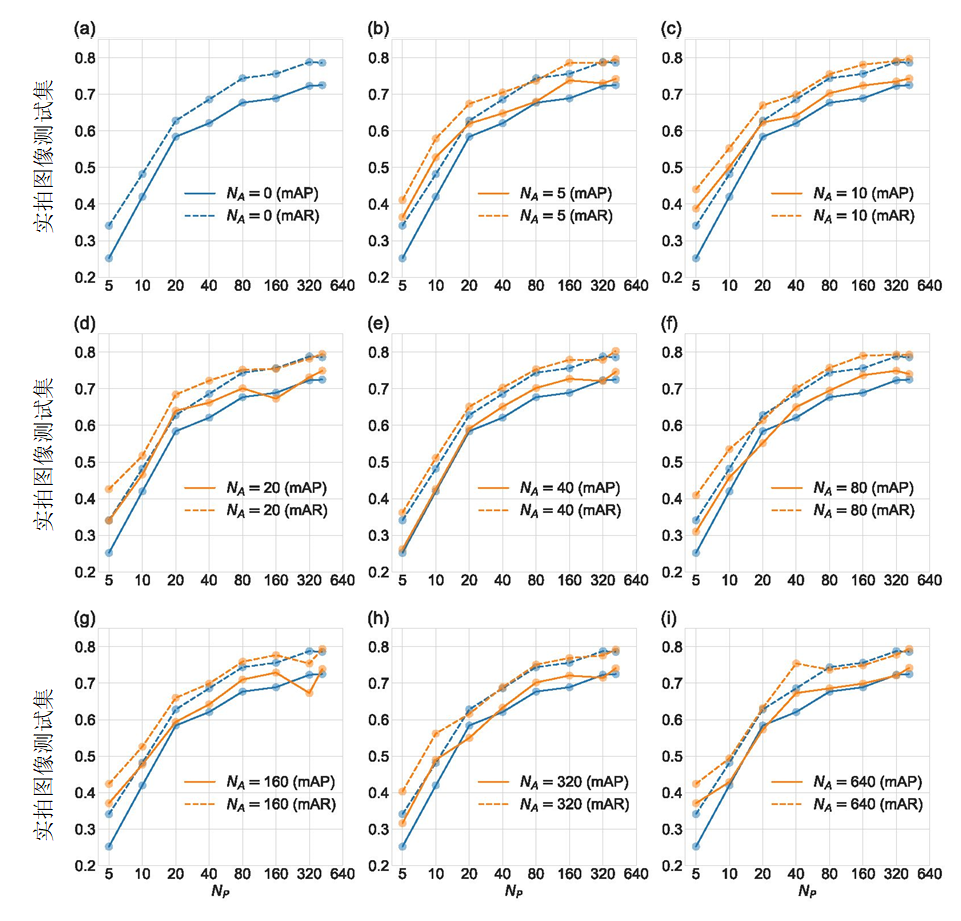

基于混合数据的训练

尽管上述结果表明,基于《武装突袭3》人造图片训练的模型不能迁移到高机动性多用途轮式车辆真实照片,但人造图片若与真实照片结合使用,则仍有可能发挥效用。项目组同时选取了《武装突袭3》人造图片和真实照片训练集,并将其分为9个图像子集。假设NA和NP分别表示《武装突袭3》生成图像和实拍照片的数量,用不同数值的NA和NP图像组成混合数据集。为研究真实照片与人造图片之比的影响,项目组考虑了前述参数的以下范围:

NP = 0,5,10,20,40,80,160,320,418

NA = 0,5,10,20,40,80,160,320,640

然后用较小的子集形成每种(NA,NP)图像的衍生数据集。每个数据集有9个子集,因此共有81个混合数据集。不过,(0,0)只是空集,所以有80个非平凡混合数据集。NA = 0或NP = 0的数据集对应上文所述的纯实拍真实照片或《武装突袭3》纯人造图片数据集。

在每个数据集上训练80个模型的结果如图7中的各图所示。左上图所示为在纯真实照片上训练的模型的性能,以供参考。所有其他图所示为在混合数据集上训练的模型的性能,其中《武装突袭3》人造图片的数量NA保持不变。在所有情况下,混合数据的表现都与真实数据相似;在许多情况下,使用混合数据进行训练可以显著提高性能,而在另一些情况下,添加人造图片会有损性能。

更详细地说,在训练的80个模型中,有64个模型是《武装突袭3》人造图片和实拍真实照片组成的混合数据集(即NA,NP均不为0)。将其中的每一个模型与未添加《武装突袭3》人造图片的对应实验模型进行性能比较可以发现,加入《武装突袭3》人造图片后,64个实验模型中,有56个实验模型的平均精确率均值有所增加,占比达87.5%。64个实验模型中有52个实验模型的平均召回率均值增加,占比达81.3%。当真实照片数量最少时,性能改进似乎最为明显。例如,在图7c中,将10张《武装突袭3》图像添加到5张实拍照片中,平均精确率均值提高了54%,平均召回率均值提高了29%。因此,将《武装突袭3》图像添加到实拍照片的现有数据集,在很大程度上有助于提高模型性能。以上结果表明,项目组采用的方法可以提高作战相关计算机视觉系统的性能,特别是在只有少数高质量真实照片可用的数据极端受限环境中。

图7 混合数据集结果:平均精确率均值与平均召回率均值曲线

(注:基于真实照片和《武装突袭3》人造图片组成的混合数据集训练的模型的性能。左上图为所有训练图像均为真实照片的情况,这组曲线也包含在所有其他图中,以便与混合模型的性能进行比较。在实拍照片数量保持不变时,添加《武装突袭3》人造图片大多可以提高模型性能。具体来说,混合模型的平均精确率均值与平均召回率均值增加的情况分别占87.5%和81.3%,高于纯实拍照片模型。)

总之,在《武装突袭3》上训练的模型不会迁移到真实照片的数据集,而在由真实照片和《武装突袭3》人造图片组成的混合数据集上训练的模型确实能迁移到真实照片的数据集。将《武装突袭3》图像添加到训练数据集,通常能提高性能。虽然性能提高程度各异,但对小数据集而言,平均精确率均值与平均召回率均值分别提高了54%和29%。

研究结论

本项目的初衷是研究在人造图片上训练的模型能否在真实照片数据集上表现良好。研究发现,人造图片训练并未迁移到真实照片,人工训练模型未发生迁移的典型结果如图6所示。然后,项目组研究了混合数据集的可迁移性,即在真实照片上训练的模型能否通过向数据集添加人造图片得以改进。实验结果表明,在许多情况下,尤其是在真实照片数量严重受限时,添加《武装突袭3》图像确实能提高性能。加入《武装突袭3》图像后,精确率提高的情况占87.5%,召回率提高的情况占81.3%,改善的幅度十分显著。例如,将10张《武装突袭3》图像添加到由5张实拍照片组成的数据集中,平均精确率均值与平均召回率均值分别提高约54%和29%。研究结果表明,在现有数据相当稀少的情况下,如果能够生成高质量的人造图片,则可以采取本文中的方法来改进模型训练。当然,要充分理解这种效应,还需要做更多的工作。

情报评述

在数据爆炸时代,大量的计算机、数字设备以及传感器都在不断地产生和存储大量数据,包括文本、数字、图像和音频等各种格式。2020年10月,美国国防部发布首份《数据战略》,概述了国防部成为“以数据为中心的机构”所需的八项指导原则,其中提出人工智能训练和算法模型的数据集将日益成为国防部最有价值的数字资产。但是,没有经过处理的海量数据并不是资源,而是一种负担,如何将大量杂乱无章、没有标记的数据转化为机器学习算法可用的训练数据确实是一个难题。

本文中的研究另辟蹊径,并没有纠缠如何将真实数据分类处理的问题,而是预设了现有可用数据有限的前提,探索用人造图片代替真实照片对算法进行训练的可能性,毕竟用人造数据来生成数据集,其时间、人力、资金等成本要低于从真实世界中获取海量数据集。尽管研究表明不能用人造图片完全取代照片,但是在只有极少量真实图片的情况下,用人造图片来补充训练数据具有一定的可行性。不过需要注意的是,本研究使用的数据集太小,其结果未必具有普适性。但是作为探索性研究,这也不失为一个可能的方向,如果使用另一种平台或方法创建三维模型是否效果更好?混合数据集应该如何配置真实数据和人造数据的比例才能更多地提升模型性能?这些问题都有待进一步研究。

发表评论